डीपफेक खतरा: यदि हर चीज नकली हो सकती है, तो आप कैसे जानेंगे कि असली क्या है?

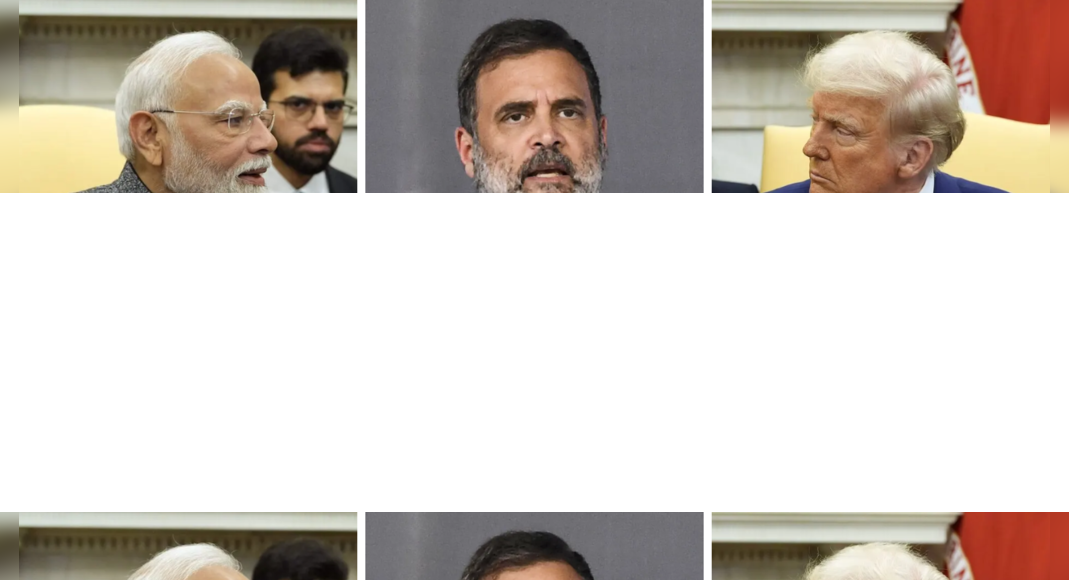

ऐसी दुनिया में जहां देखने पर अब विश्वास करना नामुमकिन है, भारत एक नए डिजिटल खतरे का सामना कर रहा है: एआई-जनित डीपफेक। ये अति-यथार्थवादी वीडियो और ऑडियो क्लिप न केवल वास्तविकता को विकृत करते हैं। वे जनता की धारणा में हेरफेर करते हैं, गलत सूचना फैलाते हैं और लोकतंत्र में विश्वास को कमजोर करते हैं। 85.5% भारतीय परिवारों के पास कम से कम एक स्मार्टफोन होने के कारण, मोबाइल फोन भारत का बैंक, कक्षा और टेलीविजन बन गए हैं, जिससे नागरिक डिजिटल धोखे के प्रति अधिक संवेदनशील हो गए हैं। उदाहरण के लिए, 2024 के चुनावों के दौरान, व्यंग्यपूर्ण डीपफेक एक प्रकार का अभियान उपकरण बन गया। मृत नेताओं को पुनर्जीवित करने के अलावा, इसमें ऐसे क्लिप भी शामिल थे जिनमें पीएम को दिखाया गया था Narendra Modi महिलाओं के साथ गरबा नृत्य और Kamal Nath एक लोकप्रिय कल्याण योजना को खारिज करना। हालांकि जांच और गिरफ्तारियां हुईं, लेकिन ऐसे वीडियो तथ्य और कल्पना के बीच की रेखा को धुंधला कर देते हैं, जिससे मतदाताओं की राय के विरूपण और लोकतांत्रिक प्रक्रिया की अखंडता को खतरा होता है। साइबर सुरक्षा विशेषज्ञों ने चेतावनी दी है कि AI भी साइबर अपराध में एक महत्वपूर्ण उपकरण बन रहा है: 2024 में 80% फ़िशिंग अभियानों में AI शामिल था, जिसमें घोटालों के लिए डीपफेक का उपयोग किया गया था। एआई के दुरुपयोग में चिंताजनक वृद्धि के बारे में पिछले साल एक टीओआई साक्षात्कार में कैलिफोर्निया विश्वविद्यालय, बर्कले के प्रोफेसर हनी फरीद ने कहा, “जब आप छवियों, ऑडियो और वीडियो को नकली बना सकते हैं, तो आपको कैसे पता चलेगा कि असली वीडियो असली है? अचानक, सब कुछ सवालों के घेरे में है।”

डीपफेक के बढ़ते खतरे से लड़ने के लिए टीओआई के साथ कमर कस लें डीपफेक का खतरा राजनीति से परे तक फैला हुआ है। हाल ही में वित्त मंत्री Nirmala Sitharaman आवाज़ों को क्लोन करने और उसकी नकल करके नकली वीडियो बनाने के लिए एआई के दुरुपयोग पर प्रकाश डाला गया, संभावित वित्तीय घोटालों और सार्वजनिक विश्वास के क्षरण की चेतावनी दी गई। मुंबई में एक कार्यक्रम में सीतारमण ने कहा, “मैंने अपने कई डीपफेक वीडियो ऑनलाइन प्रसारित होते देखे हैं, जिनमें नागरिकों को गुमराह करने और तथ्यों को विकृत करने के लिए हेरफेर किया गया है।” उन्होंने कहा, “अपराधी आवाजों की नकल करने, पहचान क्लोन करने और लोगों को प्रभावित करने वाले जीवंत वीडियो बनाने के लिए एआई का उपयोग कर रहे हैं।” पर्यवेक्षकों का कहना है कि यह देखते हुए कि भारत के 15 से 29 वर्ष के 97% से अधिक शहरी युवाओं के पास स्मार्टफोन है, इस तरह की गलत सूचनाओं का एक पीढ़ी पर प्रभाव चिंताजनक है। प्रोफेसर फरीद ने कहा, “डीपफेक की शुरुआत 2016 में हुई थी। तब, यह एक मजाक था। लेकिन तकनीक केवल बेहतर हो गई है। पहले, फोटोशॉप्ड फेस स्वैप होते थे। अब लिपसिंक फेक हैं।” उन्होंने चेतावनी देते हुए कहा कि तकनीक अधिक परिष्कृत हो गई है, जिससे गैर-सहमति वाली यौन छवियों के उपयोग के माध्यम से महिलाओं के उत्पीड़न का खतरा बढ़ गया है। नवंबर 2023 में, अभिनेत्री Rashmika Mandanna वह एक वायरल डीपफेक वीडियो का शिकार हो गई, जिसमें उसके चेहरे को आपत्तिजनक सामग्री के साथ जोड़ दिया गया, जिससे व्यापक आक्रोश फैल गया। फरीद ने नए शब्द ‘जेनरेटिव एआई’ को पुरुष-प्रधान तकनीकी उद्योग द्वारा चतुर “रीब्रांडिंग” बताते हुए कहा, “‘डीपफेक’ शब्द एक रेडिट उपयोगकर्ता से आया है, जिसने इस तकनीक के शुरुआती दिनों में इसका इस्तेमाल पोर्न बनाने के लिए किया था।” जैसे-जैसे एआई विकसित हो रहा है, भारत को मजबूत होना होगा कानूनी विशेषज्ञों का कहना है कि फ्रेमवर्क, डिजिटल साक्षरता को बढ़ाना और सुरक्षा सुनिश्चित करने के लिए विभिन्न क्षेत्रों के लोगों को एक साथ लाना है। फरीद ने कहा, “हमें हर चीज़ को असली या असली नहीं के रूप में लेबल करने की ज़रूरत है।” उन्होंने कहा, “हमें वास्तविक खुलासे की जरूरत है।” डीप फेक के बढ़ते खतरे से निपटने के लिए टीओआई ने पहले से ही तैयारी शुरू कर दी है। सूचित और जागरूक रहने के लिए हमारी ‘धोखा न खाएं’ कहानियों पर नजर रखें। आख़िरकार, जैसा कि फ़रीद कहते हैं, “यदि आप नहीं जानते कि वास्तविक क्या है, तो आप कैसे जानेंगे कि झूठ क्या है”?

(टैग्सटूट्रांसलेट)इंडिया(टी)इंडिया न्यूज(टी)इंडिया न्यूज टुडे(टी)टुडे न्यूज(टी)गूगल न्यूज(टी)ब्रेकिंग न्यूज(टी)निर्मला सीतारमण(टी)रश्मिका मंदाना(टी)नरेंद्र मोदी(टी)कमल नाथ(टी)लीगल(टी)वायरल फीवर(टी)डिजिटल इंडिया(टी)एआई-जनरेटेड डीपफेक